从机器人到药物设计,我们很难错过近期在新闻和我们办公室里的“深入学习”。事实上,视觉是在我们的分类工作中利用深度学习和卷积神经网络。什么是深度学习,为什么这么多人都听说过?这篇文章针对的是数据科学家和机器学习实践者,他们可能听说过一些关于深度学习的知识,并且对了解这些嗡嗡声是什么感兴趣。不管你的背景如何,希望你能看到如何深入的学习可以应用到你的领域。至少,你会有更好的装备来接受媒体关于深度学习的报道!

深度学习,是什么?

简单地说,深入学习是:

1、大量的统计机器学习技术

2、支持特征层次的自动学习。

3、通常基于人工神经网络

这就是要点。对于一些看起来相当直截了当的事情,在新闻中有很多关于已经取得的成就和将来可能用深度学习技术所做的事情的炒作。让我们从一个已经取得的成就的例子开始,来说明为什么它得到了如此多的关注。

然而,一个常见的误解是“深度学习”和“无监督学习”是同一个概念。目前有许多与神经网络无关的无监督学习技术,几十年来,神经网络一直被用于有监督的学习任务。此外,近年来,采用强化或半监督学习的深度学习方法得到了成功的应用,但后两种方法已经使用了几十年。

较重要的是,深度学习擅长于基本单元、单个像素、单个频率或单个单词/字符本身几乎没有意义的任务,但这些单元的组合具有有用的意义。

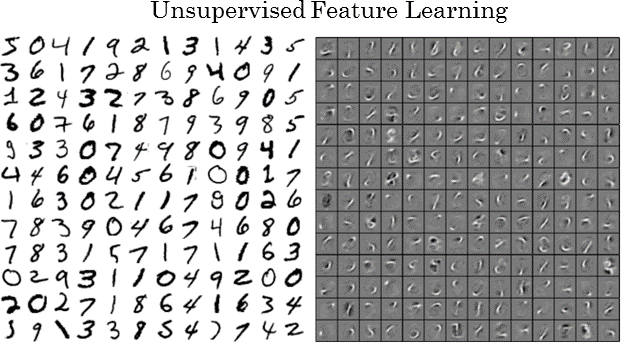

深入学习可以在没有人类干预的情况下学习这种有用的价值观组合。在讨论深度学习从数据中学习特征的能力时,普遍使用的示例是手写数字的MNIST数据集。当有数以万计的手写数字时,深度神经网络可以了解到,当试图对数字进行分类时,寻找循环和线条是很有用的。

原始输入数字在图像的左边。在右边,我们看到了学习特性(过滤器)的图形表示。从本质上讲,网络学会了检测线路和环路。

标准的神经网络是由“神经元”层组成的

这些层通常只是前馈,并通过实例进行训练(用于分类或回归)。灵长类动物的大脑在视觉皮层上也会做类似的事情,所以希望在神经网络中使用更多的层,可以让它学习更好的模型。然而,研究人员发现,具有多层结构的训练模型不起作用。一般的理解是,只有浅层网络(1-2层)才能被成功地训练.标准的浅层神经网络只有一层数据表示(见下图)。在深度神经网络中学习,其中一个有一个或两个以上的数据表示层,似乎是不可行的。事实上,深度学习已经存在很久了,就像神经网络一样–我们只是无法让它发挥作用。

神经网络中的每个连续层都使用上一层的特征来学习更复杂的特征。

在较低的级别上,网络专注于本地对比的模式,这是非常重要的。然后,下面这一层就可以使用这些局部对比的模式来专注于类似眼睛、鼻子和嘴巴的东西。顶层能够将这些面部特征应用到人脸模板中。深层神经网络能够在其连续的每一层中合成复杂程度越来越高的特征。

正是这种对数据表示和特性的自动学习,才是炒作的全部内容。这种深度神经网络的应用已经出现了一些模型,它们成功地学习了图像、音频和书面语言的有用的层次表示。这些领域中的这些学习特性层次结构可以解释为:

图像识别:像素→边缘→纹理→母模→部件→对象

文本:字符→单词→词组→子句→句子

讲演:样品→光谱带→声音→电话→音素

其中一些曾经被认为是机器学习中的难题,这就是为什么深层神经网络引起了如此多的关注。可以肯定的是,深造将是未来更多项目的秘密要素。

总之,这些突破使深层神经网络能够自动学习丰富的数据表示。这一成就在计算机视觉、语音识别和自然语言处理等领域特别有用。

卷积神经网络

卷积神经网络(CNNs)是一种深度学习的变体,是通过对视觉皮层局部敏感和定向选择性神经细胞的神经生物学研究而产生的。卷积神经网络是一种特殊的多层神经网络,它具有以下特点:CNN是一种从图像中提取拓扑特征的前馈网络。和其他几乎所有的神经网络一样,它是由反向传播算法的一个版本来训练的。CNN的设计是为了直接从像素图像中识别视觉模式,并进行小到无预处理.它们可以识别具有可变性的模式,如手写文本和自然图像。CNN通常由卷积层、次采样层和完全连接层组成。在CNN中,连续的卷积和次采样层通常是交替的。

卷积神经网络直到近期才成为计算机视觉应用的主流。在过去的3年中,cnn在计算机视觉问题上取得了较先进的性能,包括图像分类、目标检测、细粒度分类、图像分割、姿态估计和自然图像中的ocr等。通常在这些工作中,CNN是以端到端的方式进行培训的,并且提供的结果比依赖精心设计的表示方式(如SIFT或HOG特性)的系统要好得多。这一成功在一定程度上可以归因于CNN对局部图像转换的内建不变性,这是它们学习数据分层抽象的能力的基础。

Vision目前在我们的分类工作中与CNN一起工作,特别是对白细胞。我们注意到,与其他分类技术相比,这种方法产生了更快、更准确的结果。我们正在推进我们在深入学习和卷积神经网络方面的工作,并期待着将这些网络的优势传递给我们的客户,继续关注!

微信在线咨询

微信在线咨询